「Python」纯干货,5000字的博文教你采集整站小说(附源码)

2021/8/27 14:06:15

本文主要是介绍「Python」纯干货,5000字的博文教你采集整站小说(附源码),对大家解决编程问题具有一定的参考价值,需要的程序猿们随着小编来一起学习吧!

目录

前言

开始

分析(x0)

分析(x1)

分析(x2)

分析(x3)

分析(x4)

完整的代码

我有话说

前言

大家好我叫善念,这是我的第二篇技术博文(第一篇讲述的是自己的经历),连续三天更新了,每天花两小时写下一个实战案例,我也是乐在其中,谢谢大家对我的支持。

今天咱们要做的是利用Python爬取整个网站上的所有小说内容,其实在我心里面,采集什么内容根本无关紧要,最重要的是大家能学习到我的分析思路,授人以鱼不如授人以渔。

开始

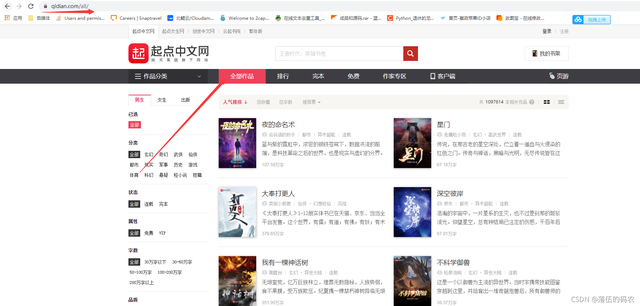

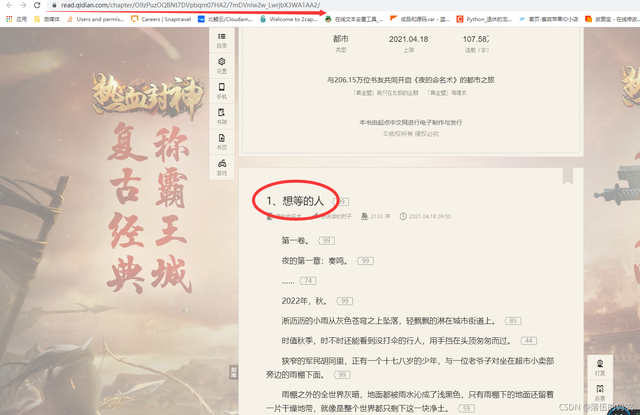

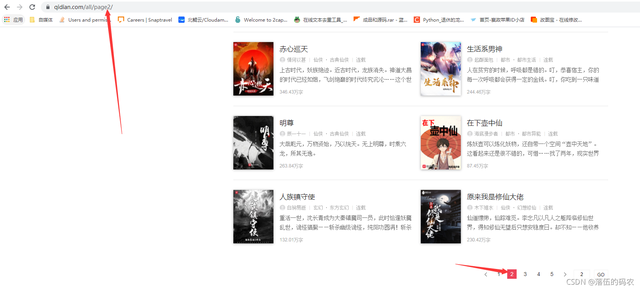

既然是要采集整站数据,那么我们进入目标网站,点击全部作品。

分析(x0)

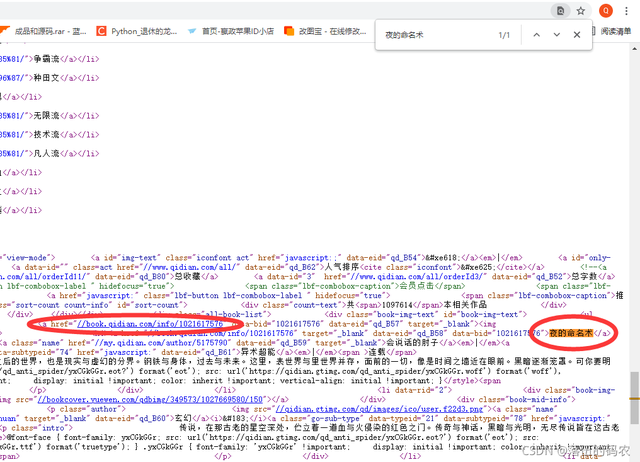

第一步右键一下查看网站源代码,看里面是否有咱们需要的书本源头文件地址(当然是看源头文件地址,因为一本书的内容这么大,然后一页有这么多本书,肯定不可能内容全部在源代码中)。

可以看到我在元素中可以找到书的名字和介绍,然后关键的是一个跳转的网址,这个网址很关键,因为咱们点击这个链接后他会跳到单本小说中。

而单本小说里面势必会有章节分类,而我们要做的肯定是需要把每本小说的章节名字也采集下来。

最终的目的就是,每本小说为一个文件夹,以书的名字命名,然后文件夹内保存所有章节,每一个章节为一个txt文档,没一个章节名与txt文件名对应。

分析(x1)

反转,切记不要以element作为源代码去考虑问题!!element可能是浏览器执行了一些JavaScript后所展现的源码,与服务器传给浏览器的源代码是有所不同的。

所以咱们还是需要在源代码中找一找是否有跳转链接和书名。

好吧,源代码中也是有的。不过你们不能大意,一定要查看源代码中是否有,element代表不了源代码。

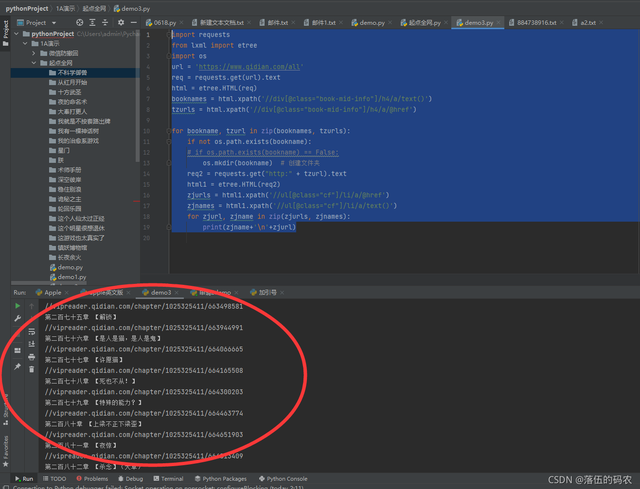

那么先采集一下第一页的书名和跳转链接咯

```

当然在学习Python的道路上肯定会困难,没有好的学习资料,怎么去学习呢?

学习Python中有不明白推荐加入交流Q群号:928946953

群里有志同道合的小伙伴,互帮互助, 群里有不错的视频学习教程和PDF!

还有大牛解答!

```

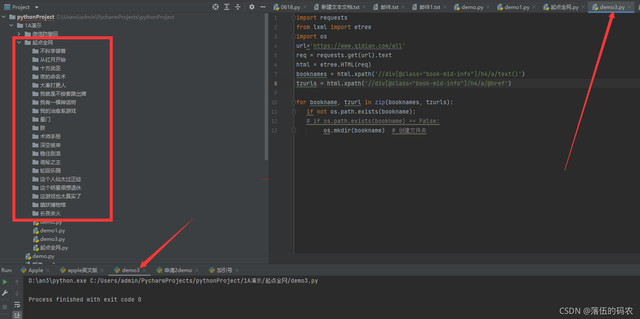

# 抓取第一页的所有书籍名字,书籍入口

# 到了书籍入口后,抓取章节名字,章节链接(文字内容)

# 保存

import requests

from lxml import etree

import os

url='https://www.qidian.com/all'

req = requests.get(url).text

html = etree.HTML(req)

booknames = html.xpath('//div[@class="book-mid-info"]/h4/a/text()')

tzurls = html.xpath('//div[@class="book-mid-info"]/h4/a/@href')

for bookname, tzurl in zip(booknames, tzurls):

if not os.path.exists(bookname):

# if os.path.exists(bookname) == False:

os.mkdir(bookname) # 创建文件夹

这里对应着咱们的思路,每采集到一个书名就给它单独创建一个文件夹。

完全没问题,到这里咱们已经完成第一步了。

分析(x2)

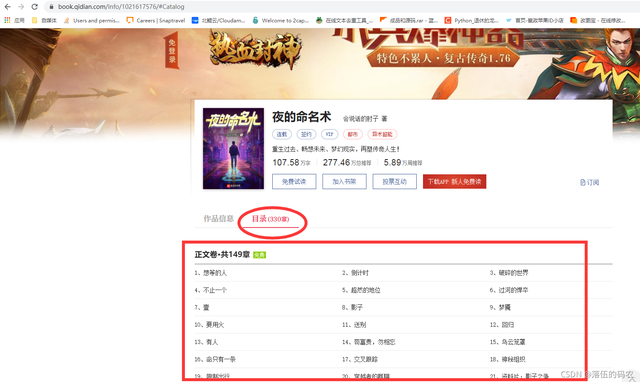

那么接下来就是去模拟请求咱们采集到的书本目录的跳转链接,然后同样的方法去采集到章节名与章节内容的跳转链接了。

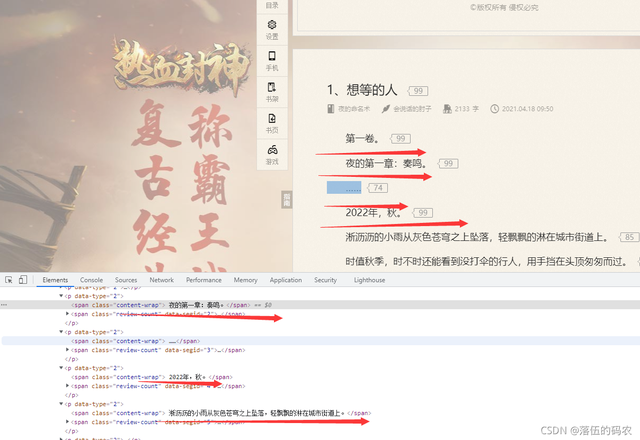

同样的你们自己查看下源代码,数据也是在里面的。

那就接着写代码咯

```

当然在学习Python的道路上肯定会困难,没有好的学习资料,怎么去学习呢?

学习Python中有不明白推荐加入交流Q群号:928946953

群里有志同道合的小伙伴,互帮互助, 群里有不错的视频学习教程和PDF!

还有大牛解答!

```

import requests

from lxml import etree

import os

url = 'https://www.qidian.com/all'

req = requests.get(url).text

html = etree.HTML(req)

booknames = html.xpath('//div[@class="book-mid-info"]/h4/a/text()')

tzurls = html.xpath('//div[@class="book-mid-info"]/h4/a/@href')

for bookname, tzurl in zip(booknames, tzurls):

if not os.path.exists(bookname):

# if os.path.exists(bookname) == False:

os.mkdir(bookname) # 创建文件夹

req2 = requests.get("http:" + tzurl).text

html1 = etree.HTML(req2)

zjurls = html1.xpath('//ul[@class="cf"]/li/a/@href')

zjnames = html1.xpath('//ul[@class="cf"]/li/a/text()')

for zjurl, zjname in zip(zjurls, zjnames):

print(zjname+'\n'+zjurl)

效果图:

分析(x3)

知道这里为什么没有去把章节名字命名的txt文档保存在文件夹内吗?

因为咱们还没有获取到章节的内容呀,是不是需要先把章节内容写到章节的txt里面,然后再保存在文件夹内?

当然这句解释是为了照顾新手。

那么接下来采集章节内容,方法什么的不讲了, 一模一样的,章节内容同样在源代码中如上上图所示。

每一个标签只保存一行内容,那么就需要用到把采集到的所有内容都组合起来,并用换行符隔开,尽量保持文章格式。

代码走起:

```

当然在学习Python的道路上肯定会困难,没有好的学习资料,怎么去学习呢?

学习Python中有不明白推荐加入交流Q群号:928946953

群里有志同道合的小伙伴,互帮互助, 群里有不错的视频学习教程和PDF!

还有大牛解答!

```

import requests

from lxml import etree

import os

url = 'https://www.qidian.com/all'

req = requests.get(url).text

html = etree.HTML(req)

booknames = html.xpath('//div[@class="book-mid-info"]/h4/a/text()')

tzurls = html.xpath('//div[@class="book-mid-info"]/h4/a/@href')

for bookname, tzurl in zip(booknames, tzurls):

if not os.path.exists(bookname):

# if os.path.exists(bookname) == False:

os.mkdir(bookname) # 创建文件夹

req2 = requests.get("http:" + tzurl).text

html1 = etree.HTML(req2)

zjurls = html1.xpath('//ul[@class="cf"]/li/a/@href')

zjnames = html1.xpath('//ul[@class="cf"]/li/a/text()')

for zjurl, zjname in zip(zjurls, zjnames):

print(zjname+'\n'+zjurl)

req3 = requests.get('http:' + zjurl).text

html2 = etree.HTML(req3)

nrs = html2.xpath('//div[@class="read-content j_readContent"]/p/text()') # 分散式内容

nr = '\n'.join(nrs)

file_name = bookname + "\\" + zjname + ".txt"

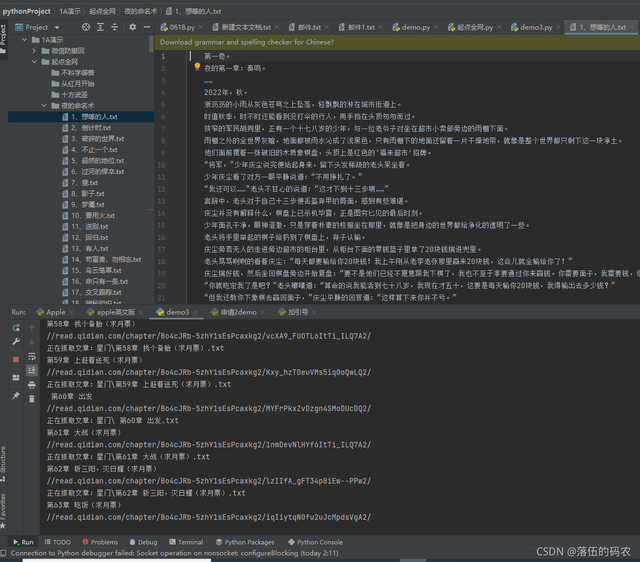

print("正在抓取文章:" + file_name)

with open(file_name, 'a', encoding="utf-8") as f:

f.write(nr)

效果图:

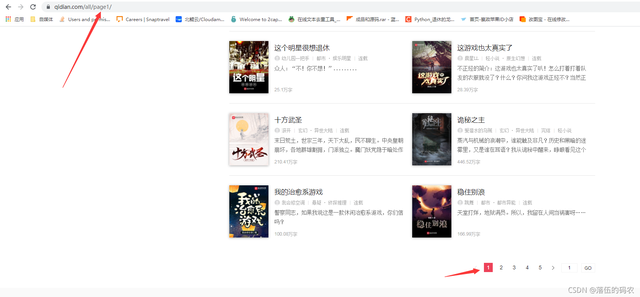

这里要说明一下,咱们还只是抓取了第一页的数据。那么如何抓取整站的数据呢?

分析(x4)

一般稍微有经验的都知道一点,就是当我们翻页的时候,网站的url会发生变化,页码一般就是在url上面。

构建个for循环把页码数变为一个变量即可,无需多言,直接上最终的完整代码,代码仅供参考,你们最终可以自己去修改效果。

完整的代码

```

当然在学习Python的道路上肯定会困难,没有好的学习资料,怎么去学习呢?

学习Python中有不明白推荐加入交流Q群号:928946953

群里有志同道合的小伙伴,互帮互助, 群里有不错的视频学习教程和PDF!

还有大牛解答!

```

import sys

import requests

from lxml import etree

import os

for i in range(sys.maxsize):

url = f'https://www.qidian.com/all/page{i}/'

req = requests.get(url).text

html = etree.HTML(req)

booknames = html.xpath('//div[@class="book-mid-info"]/h4/a/text()')

tzurls = html.xpath('//div[@class="book-mid-info"]/h4/a/@href')

for bookname, tzurl in zip(booknames, tzurls):

if not os.path.exists(bookname):

# if os.path.exists(bookname) == False:

os.mkdir(bookname) # 创建文件夹

req2 = requests.get("http:" + tzurl).text

html1 = etree.HTML(req2)

zjurls = html1.xpath('//ul[@class="cf"]/li/a/@href')

zjnames = html1.xpath('//ul[@class="cf"]/li/a/text()')

for zjurl, zjname in zip(zjurls, zjnames):

print(zjname+'\n'+zjurl)

req3 = requests.get('http:' + zjurl).text

html2 = etree.HTML(req3)

nrs = html2.xpath('//div[@class="read-content j_readContent"]/p/text()') # 分散式内容

nr = '\n'.join(nrs)

file_name = bookname + "\\" + zjname + ".txt"

print("正在抓取文章:" + file_name)

with open(file_name, 'a', encoding="utf-8") as f:

f.write(nr)

我有话说

——女朋友就是私有变量,只有我这个类才能调用(纪念分手的第二周

emmm本来以前是录制过视频教程的,但是由于从上家公司离职后丢失了。在这里跟大伙说声抱歉。

但是文章的话是现写的,每篇文章我都会说得很细致,所以花费的时间比较久,一般都是两个小时以上,每篇文章达到五千字左右。

原创不易,再次谢谢大家的支持。

① 2000多本Python电子书(主流和经典的书籍应该都有了)

② Python标准库资料(最全中文版)

③ 项目源码(四五十个有趣且经典的练手项目及源码)

④ Python基础入门、爬虫、web开发、大数据分析方面的视频(适合小白学习)

⑤ Python学习路线图(告别不入流的学习)

``` 当然在学习Python的道路上肯定会困难,没有好的学习资料,怎么去学习呢? 学习Python中有不明白推荐加入交流Q群号:928946953 群里有志同道合的小伙伴,互帮互助, 群里有不错的视频学习教程和PDF! 还有大牛解答! ```

这篇关于「Python」纯干货,5000字的博文教你采集整站小说(附源码)的文章就介绍到这儿,希望我们推荐的文章对大家有所帮助,也希望大家多多支持为之网!

- 2024-12-27Python编程基础教程

- 2024-12-27Python编程基础指南

- 2024-12-24Python编程入门指南

- 2024-12-24Python编程基础入门

- 2024-12-24Python编程基础:变量与数据类型

- 2024-12-23使用python部署一个usdt合约,部署自己的usdt稳定币

- 2024-12-20Python编程入门指南

- 2024-12-20Python编程基础与进阶

- 2024-12-19Python基础编程教程

- 2024-12-19python 文件的后缀名是什么 怎么运行一个python文件?-icode9专业技术文章分享